Noticias

Lo Ultimo

Entrevista a Gisela Riuli. Aeropuerto Sauce Viejo

La presidenta del Directorio del Aeropuerto Metropolitano, nos cuenta acerca de la situación actual de la terminal aeroportuaria

Locales

Franco Colapinto en el GP de Austria de la Fórmula 1: cuándo corre, horarios y cómo ver

Después de una semana de descanso, la Máxima vuelve este fin de semana por la 11° fecha, y el pilarense se subirá al Alpine en el circuito Red Bull Ring de Spielberg.

Internacionales

Indemnizaciones laborales: el Gobierno reglamentó que los trabajadores se paguen su propio despido

La Comisión Nacional de Valores publicó en el Boletín Oficial la Resolución General 1071/2025. La entidad será la que regule los Fondos Comunes de Inversión de Cese Laboral.

Nacionales

El Gobierno elimina el antidumping a los termos chinos y pone fin a la protección al único fabricante nacional

La medida podría generar una baja de precios para los consumidores, pero también pone en riesgo la supervivencia de la única fábrica nacional de termos.

Nacionales

Déficit externo récord en el primer trimestre: el país perdió U$S5.191 millones y el FMI enciende alertas

Excedió las estimaciones y pone el foco de discusión en el atraso cambiario y en su forma de financiamiento. Récord histórico en el rojo por servicios.

Nacionales

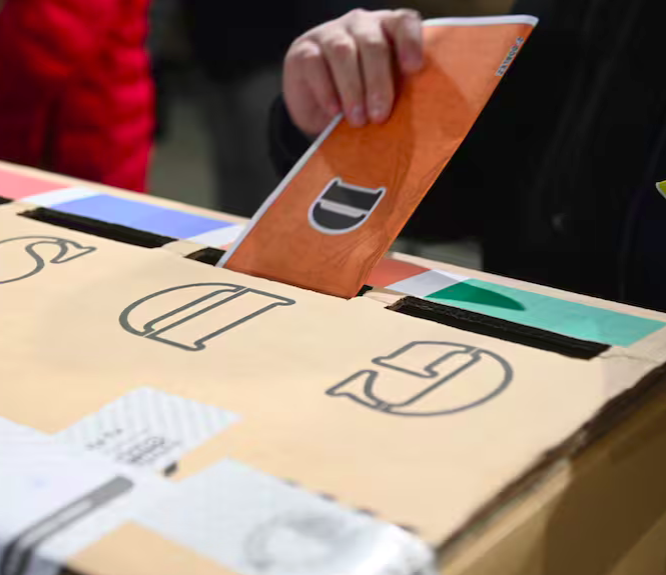

Fin de la Campaña Política.

Desde las 8, candidatos y partidos ya no pueden difundir propuestas, pero en redes sociales seguirán la campaña. Alcances de la veda en territorio santafesino

Provinciales

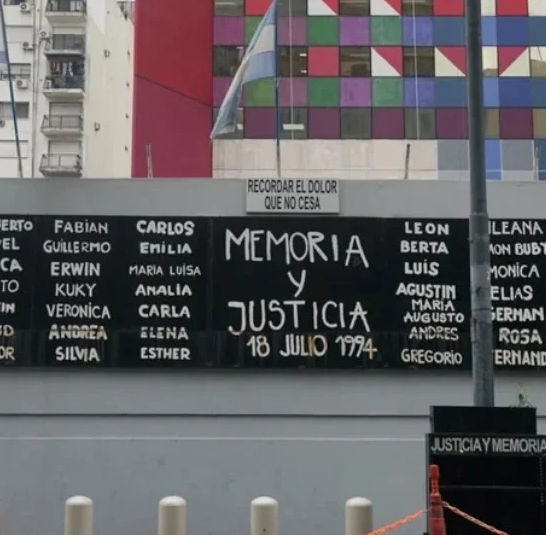

Atentado a la AMIA: juzgarán en ausencia a los acusados iraníes y libaneses

El juez federal Daniel Rafecas aplicó por primera vez la nueva normativa que permite avanzar con procesos penales sin la presencia de los imputados, ante la negativa reiterada de los prófugos a someterse al expediente.

Nacionales

Cómo afecta la calefacción del hogar a los animales durante el invierno

El calor artificial puede alterar su comportamiento, provocar molestias respiratorias y generar riesgos si no se toman precauciones dentro de los ambientes cerrados.

Locales

Una presentación voluntaria para desligarse de la criptoestafa

El "speech" de Hyden Davis consistió en decir que "el proyecto era privado" y estaba destinado a ayudar pequeñas empresas argentinas. Deslizó cierta responsabilidad hacia Milei.

Internacionales

Multitudinaria marcha contra el ajuste de la Universidad

Movilización Federal convocada por el Frente Sindical de Universidades Nacionales, con actos en distintas ciudades del país bajo la consigna: "¡Prendete a defender la universidad pública!".

ProvincialesNueva denuncia penal contra Manuel Adorni: ahora, por el viaje en vuelo privado a Punta del Este

"El vuelo a Punta del Este lo pagó Manuel Adorni": la confirmación del compañero de viaje en vivo a C5N

El descargo de Victoria Villarruel por el aumentazo de dietas: "Queda a criterio de cada senador donarlo"

Hasta Joni Viale destrozó a Manuel Adorni por sus viajes: "O se gastó el 25% de sus ahorros o es una dádiva"

Córdoba: un hombre se enfrentó a un ladrón para evitar un robo en su casa y murió de un paro cardíaco

Alerta por una amenaza de bomba en la AMIA y la Embajada de Israel

Tres apostadores se repartieron $1.560.000.000 con el Quini 6: cuánto se llevó cada uno

Detuvieron al "Chelo" Torres del Grupo Green tras ser denunciado por violación

Sandra Pettovello decretó un aumento para jubilados de Anses en junio

Informe del FMI: el organismo reconoce un déficit fiscal de 0,8% del PBI

ANSES: cómo hacer para jubilarse, sin llegar a los 30 años de aportes

ANSES: el extra confirmado para junio y que beneficiará a un grupo de personas

Google I/O 2026: cómo ver en vivo la conferencia clave sobre inteligencia artificial

Revelaciones de la IA: la humanidad estaría cada vez más cerca de la inmortalidad

El fenómeno BookTok: cómo TikTok está redefiniendo la forma en que leemos

Google lanza Fuentes Preferidas: cómo agregar a minutouno.com

Videos

Inundaciones en Vera

Inundaciones en Vera

Movilización de Festram - 28 de Mayo 2025

Palabras al Viento - Programa 01/06/2025

Mentes Curiosas

Monica Ledesma - Feria Amor y Arte

Laura Chatelain - Un SOlo Corazón Oficial

María Arenales - Jardín Nro. 370

Noticias 04/06/2025

Santa Rosa de Lima 1997

Antropo...que??

Entrevista a Rusty

Entrevista a Susana Debiasi

Josefina Manso. Jefa Dpto. Jurídico Tribunal Electoral

Radio Rock

Descripcin: Todo el rock naciona e internacional

Locutor: Nani

Da: Viernes

Hora: 21:00:00 - 23:00:00

Amo Sauce Viejo

Descripcin: Magazine diario

Locutor: Fabián Chesa

Da: Lunes, Martes, Miércoles, Jueves, Viernes

Hora: 10:00:00 - 12:00:00

Encuestas

¿Te suscribiste a nuestro canal de youtube?

Resultados:

- Si7 votos

- Lo pensaba hacer1 votos

- mmm... no tengo idea1 votos

- No0 votos

Encuestas

¿Tenés decididio tu voto para las próximas elecciones a Intendente?

Resultados:

- Si11 votos

- No0 votos

Encuestas

¿Tenés decidido tu voto a concejal para la próximas elecciones?

Resultados:

- Si5 votos

- No0 votos